Eleven Labs

Des experts augmentés par l'intelligence collective.

Des experts augmentés par l'intelligence collective.

Découvrez les meilleures agences Datalake en France, sélectionnées pour leur expertise pointue et leur parfaite compréhension des enjeux locaux liés à la gestion et à l’exploitation des données massives. Les professionnels français du secteur Datalake maîtrisent les spécificités du marché hexagonal et accompagnent les entreprises dans la structuration, le stockage et l’analyse efficiente de leurs données. Grâce à leur savoir-faire à la fois technique et stratégique, ces agences situées en France proposent des solutions sur mesure, adaptées aux besoins des organisations de toutes tailles. Parcourez la sélection experte réalisée par La Fabrique du Net pour identifier l’agence Datalake la plus à même de vous guider dans le développement de vos projets data, en bénéficiant de l’assurance d’un choix éclairé et fiable.

Des experts augmentés par l'intelligence collective.

Des experts augmentés par l'intelligence collective.

Des experts augmentés par l'intelligence collective.

Des experts augmentés par l'intelligence collective.

Accompagnement sur mesure sur vos projets IA et Data

Accompagnement sur mesure sur vos projets IA et Data

Retail / E-commerce / Consommation

Industrie / Énergie / Ingénierie

Immobilier / Construction / BTP

Retail / E-commerce / Consommation

Vous avez du mal à choisir votre agence ? Laissez-nous vous aider gratuitement

DreamOnTech vous propulse au-delà de l'imagination !

DreamOnTech vous propulse au-delà de l'imagination !

Smartfire pilote la fusion de la tech, de la data et de l’IA pour transformer votre site web en moteur de croissance.

Smartfire pilote la fusion de la tech, de la data et de l’IA pour transformer votre site web en moteur de croissance.

Votre équipe web, mobile, IA

Votre équipe web, mobile, IA

Hyperstack accompagne les entreprises à devenir plus performantes et data-driven grâce au no-code, à la data et à l’IA.

Hyperstack accompagne les entreprises à devenir plus performantes et data-driven grâce au no-code, à la data et à l’IA.

Benjamin P.

Ben&Vic

09/2025

Formation / Coaching / RH

One Learn forme des professionnels autour de l’architecture et du design, avec une activité en forte croissance.Pour mie...

Services B2B / SaaS / Logiciels

Copernic souhaitait disposer d’une infrastructure data robuste afin de centraliser ses données Divalto, d’améliorer leur...

Économie sociale / ONG / ESS

Grâce à une transformation technique en profondeur, Agoterra bénéficie désormais d’un back-end solide, automatisé et évo...

Retail / E-commerce / Consommation

Grâce à une automatisation complète du traitement de ses commandes en ligne, SVR dispose désormais d’un flux de données...

CRM, IT, DATA, IA

CRM, IT, DATA, IA

Thibaut P.

Gérant • Numenys

12/2025

Virtuous Innovators

Virtuous Innovators

Partenaire de votre transformation Data & IA

Partenaire de votre transformation Data & IA

Ismail M.

Lead Data Engineering - Data Platform Team • Accor

01/2026

Manuel D.

CTO • Madkudu

01/2026

Adrien P.

CTO • Citron

01/2026

Industrie / Énergie / Ingénierie

Contexte Notre client met au point une solution pour digitaliser la gestion énergétique et technique des biens immobilie...

Tourisme / Hôtellerie / Restauration

Objectif de la mission Les dispositifs de fidélité constituent un levier puissant pour une marque, permettant de valoris...

Des solutions digitales uniques, créées pour vos besoins

Des solutions digitales uniques, créées pour vos besoins

Stanislas D.

CEO • Healthcube

03/2026

De l’UX à l’IA, un partenaire digital pour toute votre chaîne de valeur.

De l’UX à l’IA, un partenaire digital pour toute votre chaîne de valeur.

Agence intelligence artificielle, machine learning et data. Experts du développement d'IA sur mesure, ou à partir d'un modèle existant.

Agence intelligence artificielle, machine learning et data. Experts du développement d'IA sur mesure, ou à partir d'un modèle existant.

Rapprochez-vous du lancement de votre prochain projet dès aujourd'hui

Notre méthodologie repose sur des critères objectifs et vérifiables pour garantir la pertinence de nos recommandations.

Voir la méthodologie détailléeClassement impartial basé sur la data. Aucune agence ne paie pour sa note.

Identité légale, santé financière et expertises sont auditées par notre équipe.

Nous modérons les avis pour filtrer les faux témoignages et garantir l'authenticité.

Découvrez les dernières réalisations des meilleures agences

Homélior

Solution Hyperstack Rappel des enjeux Homélior, acteur clé de la rénovation énergétique, évolue dans un secteur exigeant, régulé par des normes complexes. Avant l’arrivée d’Hyperstack, les procédures étaient gérées manuellement avec des fichiers Excel, non reliés aux outils métiers. Cette méthode induisait des étapes longues et répétitives, une gestion massive des échanges e-mail avec les partenaires principaux, et un réel manque de visibilité sur la progression des dossiers. Résultat : des frustrations pour les partenaires comme pour les équipes d’Homélior, impactant fortement la performance du département financier. Solutions apportées Hyperstack a conçu une solution personnalisée en développant une application centralisée intégrant les trois pôles majeurs d’Homélior : conformité, finance et juridique. Cette plateforme unifiée facilite le pilotage de toutes les opérations. Une interface spécifique a été créée pour les partenaires, leur assurant un suivi en temps réel de leurs dossiers, ce qui réduit significativement les échanges d’e-mails et la charge de travail des équipes. De plus, les processus ont été rationalisés grâce à l’automatisation de tâches essentielles, comme la création des factures, et à une connexion fluide avec les outils existants d’Homélior, supprimant ainsi les erreurs liées aux manipulations manuelles. Résultats 25 heures de travail économisées chaque semaine pour le département finance. Stack d’outils La stack technique repose sur Airtable, structurant les informations par service afin de limiter les accès aux seules données utiles. Une interface dédiée aux partenaires, développée via MiniExtension, propose des vues personnalisées selon les étapes des projets. L'automatisation de la facturation s’appuie sur Google Drive. L’outil bénéficie également de connexions à Pennylane et aux systèmes de communication traditionnels (Slack, e-mail). Fonctionnalités développées Outil ERP sur mesure Extranet sécurisé Génération automatique de documents L’ERP centralise l’ensemble des données stratégiques et permet d’automatiser de nombreuses tâches, telles que la création de factures. Il propose aussi une interface publique à destination des partenaires, ainsi qu’une interface dédiée pour les équipes externes. Une intégration personnalisée via une API métier spécifique renforce l’efficacité des opérations. Avis clients « Hyperstack a révolutionné nos méthodes de travail grâce à l’automatisation sur Airtable et la création d’une interface partenaire sur mesure. Moins d’erreurs, moins d’e-mails, et une forte montée en productivité de notre équipe. Bravo à l’équipe Hyperstack ! » Laura Puddu, Chief Operating Officer (COO)

Copernic

Copernic souhaitait disposer d’une infrastructure data robuste afin de centraliser ses données Divalto, d’améliorer leur qualité et d’activer automatiquement leur envoi vers HubSpot.Grâce à une modernisation complète basée sur une stack moderne, Copernic bénéficie désormais d’un environnement unifié, évolutif et capable de supporter de nouveaux cas d’usage analytiques et CRM.Solution HyperstackContexteLes équipes Copernic manipulaient leurs données Divalto via des fichiers Excel exportés manuellement.Avec l’augmentation du volume d’activité, cette approche montrait ses limites :Traitements manuels lourds et difficilement maintenablesHétérogénéité des formats et faible cohérence des donnéesImpossible d’alimenter HubSpot avec des informations fiables et structuréesManque d’un socle analytique permettant des transformations automatiséesCes contraintes ralentissaient les processus internes et empêchaient l’automatisation des flux métiers.Solution apportéeHyperstack a conçu une architecture data moderne permettant de centraliser, transformer et activer les données Divalto :Centralisation des données dans OnelakeUn data lake unifié pour structurer l’ensemble des données brutes Divalto.Modélisation et transformation via dbtStandardisation des règles métiers, création de modèles SQL et normalisation complète des tables.Versioning et fiabilisation via GitHubUne gestion claire des transformations, facilitant la maintenance et l’évolution future.Activation HubSpot automatiséeMise en place possible d’un pipeline d’envoi via n8n ou Google Cloud Function pour synchroniser les données prêtes à l’usage.RésultatsDonnées Divalto centralisées et fiabilisées dans un environnement uniqueTransformation standardisée grâce à un projet dbt structuréSynchronisation HubSpot activable sans manipulation ExcelRéduction massive du travail manuel et amélioration de la cohérence des donnéesArchitecture scalable, prête pour les futurs besoins analytiques de Copernic

Parfumsplus

Mission : Un acteur du secteur de la parfumerie souhaitait dépasser les limites des solutions AMDIS et Excel pour analyser ses données GC-MS et accélérer la reformulation de ses fragrances. Pour répondre à ce besoin, nous avons conçu une plateforme d’intelligence artificielle spécialement dédiée à la parfumerie. Celle-ci centralise les bibliothèques de molécules et matières naturelles, génère une formule globale polaire/apolaire, permet la superposition des chromatogrammes de marché et d’essai, et offre un module de redosage incluant des coefficients de réponse. Grâce à cette approche unifiée, analyse et reformulation sont désormais réunies au sein d’un même outil, sans utilisation de tableurs, avec une traçabilité totale et des données prêtes à alimenter des modèles d’IA. Ce projet démontre concrètement l’apport de l’IA appliquée au GC-MS dans l’évolution de la formulation de parfums et l’optimisation du travail des analystes. Problématique : Chez Parfumsplus, les équipes d’analyse travaillaient avec une succession d’outils non connectés — principalement AMDIS pour l’analyse GC-MS, et Excel pour la formulation et le redosage. Ce fonctionnement engendrait une perte de temps due aux ajustements manuels, un déficit de traçabilité des choix réalisés, ainsi qu’une impossibilité de standardiser les étapes de reformulation. Chaque analyste appliquait alors ses propres méthodes, avec un risque élevé d’erreurs ou d’incohérences. Objectifs : Le client visait à remplacer cette organisation morcelée par une plateforme unifiée capable de centraliser toutes les librairies de molécules et matières naturelles, de générer automatiquement une formule globale T/TA, d’intégrer un module de redosage basé sur des marqueurs et des coefficients de réponse, de comparer visuellement les essais par overlay des chromatogrammes et de constituer une base d’apprentissage robuste pour fiabiliser l’identification moléculaire. Solution livrée : Nous avons développé et déployé une plateforme IA métier spécialement pensée pour les analystes parfumeurs, intégrant un moteur d’identification basé sur Spec2Vec et NNLS, un chromatogramme interactif, une formule T/TA, un module de redosage intelligent, un overlay visuel, un système d’ajout manuel guidé, l’archivage des données et la possibilité d’ajouter prochainement de nouveaux modules IA. La plateforme, pleinement opérationnelle, est utilisée au quotidien et apporte une traçabilité intégrale ainsi qu’un gain de productivité significatif. Élimination complète d’Excel pour toutes les opérations, garantissant une traçabilité à 100 % Diminution du temps d’analyse jusqu’à 50 % pour le redosage et la comparaison des chromatogrammes grâce à l’automatisation IA Historisation de chaque ajout, sauvegarde continue des coefficients, création d’une base de données prête pour l’entraînement de modèles IA Zones de déploiement : Paris & Île-de-France, Grasse (06), Lyon et la région Auvergne-Rhône-Alpes, ainsi qu’un mode à distance pour les laboratoires installés en Europe. Témoignage client : « Nous avions besoin de sortir d’un fonctionnement artisanal basé sur AMDIS et Excel pour fiabiliser nos analyses GC-MS et accélérer nos reformulations. Koïno a rapidement compris nos enjeux métier et livré une plateforme claire, robuste et immédiatement exploitable. Le gain de temps est réel, le redosage est devenu maîtrisable, et chaque ajout est désormais traçable. C’est un outil que l’on utilise au quotidien. »

Pure

Plateforme Data/IA d'enrichissement de données

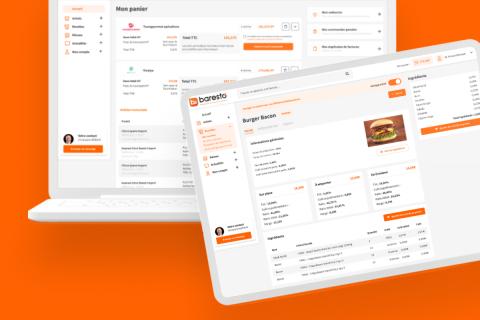

Baresto

Une plateforme sur-mesure pour optimiser les achats en CHR Le numérique permet d’optimiser les achats pour le premier réseau français de bars, cafés et restaurants indépendants. Dès 2015, Baresto a choisi de se tourner vers le digital afin de développer ses activités. Un vaste projet de transformation numérique a ainsi été lancé avec Spiriit. Des résultats Multiplication par 5 du chiffre d’affaires sur les achats en 5 ans 9 années de partenariat 10 000 références produits au catalogue Digitaliser les habitudes d’achat des restaurateurs Le défi consiste à créer une plateforme capable de gérer un catalogue très volumineux tout en proposant une expérience digitale fluide et personnalisée à chaque adhérent. Une approche centrée sur l’expérience utilisateur et la data L’une des clés du succès de la plateforme réside dans l’expérience utilisateur. Dès le départ, plusieurs ateliers ont permis d’identifier les besoins fonctionnels et l’ergonomie à privilégier. Les données collectées constituent un atout précieux pour optimiser les achats et proposer des tableaux de bord clairs et pertinents. Design system Pour faciliter l’intégration et l’évolution de la plateforme, Spiriit a conçu un Design system. Cette bibliothèque d’éléments graphiques permet de générer rapidement de nouveaux gabarits de pages. Cette charte graphique digitale garantit l’évolution des lignes directrices tout en maintenant une cohérence visuelle forte. L’expérience utilisateur avant tout Les fonctionnalités sont élaborées avec l’aide d’utilisateurs pilotes. Des prototypes servent à valider l’utilisabilité et l’efficacité des solutions avant leur développement complet. Nos actions pour relever le défi Cadrage projet Story Mapping Sprint Design by Spiriit Les données au service de l’optimisation des achats Chaque jour, plusieurs milliers de produits sont commandés via la plateforme. Ces données alimentent des tableaux de bord complets permettant aux adhérents de se comparer aux autres membres. Les partenaires Baresto peuvent également ajuster leurs prix selon la demande grâce à ces analyses. Une plateforme Symfony multi-profils et interconnectée au service de la filière Pour générer de la valeur, la plateforme s’adresse à différents profils : professionnels adhérents, équipe Baresto, partenaires et distributeurs. L’architecture Symfony garantit la sécurité des accès et l’interconnexion entre les divers systèmes d’information. Sécuriser l’exploitation d’une plateforme à haute criticité business En constante évolution fonctionnelle, la plateforme doit supporter de nombreux déploiements en sécurité grâce à une CI/CD intégrant des tests automatisés. Une architecture redondante assure une très haute disponibilité. Performance et gestion du haut volume via Elastic Search La gestion d’importants volumes de données, qu’il s’agisse du catalogue ou des commandes journalières, ainsi que la personnalisation des tarifs par adhérent, ont conduit à adopter Elastic Search pour garantir des performances optimales. Une factory digitale pérenne La transformation digitale se construit dans la durée ! L’équipe Spiriit s’engage dans la durée sur plusieurs années. La gestion de projet kanban permet de fluidifier et d’optimiser la productivité des équipes. Témoignage client Grâce à Spiriit et à la forte mobilisation des équipes, notre plateforme digitale nous permet aujourd’hui de tenir un rôle pionnier sur notre marché. Notre outil évolutif accompagne la croissance de notre réseau avec des services à forte valeur ajoutée. Nous ne sommes qu’au début de la digitalisation dans la restauration ; d’autres évolutions fonctionnelles sont encore à venir ! Hervé Pitault Fondateur & CEO – Baresto

SVR

Grâce à une automatisation complète du traitement de ses commandes en ligne, SVR dispose désormais d’un flux de données robuste et conforme. Cette solution invisible mais essentielle permet de transformer des ventes complexes (bundles, remises, devises) en fichiers prêts à l’intégration dans Sage X3.Résultat : des données plus fiables, un chiffre d’affaires consolidé automatiquement et un pilotage simplifié de l’activité e-commerce.Solution HyperstackContexteDepuis janvier 2025, une des marques de SVR a enregistré plus de 45 000 commandes sur sa boutique Shopify. Ces données devaient être intégrées dans Sage X3. Mais il n’existait pas de connecteur direct et le volume était trop important pour un traitement manuel.Les difficultés :Bundles à éclater et valoriser article par articleRemises à répartir correctement sur chaque produitGestion des devises et des codes clients Sage X3Besoin de consolider le chiffre d’affaires mensuelSolution ApportéeHyperstack est intervenu en deux étapes.D’abord, un retraitement ponctuel a permis de produire un fichier .csv conforme à Sage X3 : décomposition des bundles, valorisation des articles, prise en compte des remises et des devises. Les ventes ont pu être intégrées rapidement dans l’ERP.Ensuite, le processus a été automatisé :Extraction quotidienne des ventes Shopify, TikTok Shop et Amazon via AirbyteTransformation et regroupement des données avec DBT et BigQueryGénération automatique des fichiers clients et dépôt sur FTP avec n8nLes résultats sont clairs :Plus de retraitements manuelsDonnées fiables et prêtes à l’intégrationChiffre d’affaires consolidé automatiquement chaque moisSolution évolutive pour intégrer de nouveaux canaux de venteAujourd’hui, SVR dispose d’un flux de données automatisé et fiable. L’entreprise gagne du temps, réduit les erreurs et pilote son e-commerce plus efficacement.

L'Oréal

Face à l’essor des données dans les entreprises françaises, une stratégie Datalake bien pensée devient un levier différenciant. Mais comment choisir la bonne agence Datalake en France alors que l’offre explose et que les besoins varient du simple stockage à l’orchestration avancée des données métiers ? Plutôt que de vous noyer dans un annuaire impersonnel ou de vous contenter d’un simple classement, cet article analyse en profondeur les réelles opportunités — pour que votre projet se traduise en valeur.

Construire, déployer et valoriser un Datalake exige un savoir-faire technique et métier solide. Voici un panorama représentatif du marché français, avec un comparatif inédit de leurs spécialités :

| Agence | Profil | Secteur de prédilection | Briques technologiques | Points forts |

|---|---|---|---|---|

| Yield Studio | Data & IA | Industrie, Retail | Azure, AWS, Google | IA, orchestration métier |

| Digitalisim | Data Marketing | PME/Grands comptes | Hubspot, Google Cloud | Marketing & CRM intégrés |

| Spiriit | Data/IA Digitale | Multisecteurs | Architecture cloud | Pilotage, performance |

| Axians | Data intégrateur | Entreprises, ETI | Solutions Cisco, AWS | Interfaçage, sécurité |

| IG Conseils (Source) | Experts-comptables | Cabinets, Finances | Plateformes spécialisées | Automatisation métiers |

N’exigez pas simplement une implantation technique : demandez à l’agence un retour d’expérience dans votre secteur, des cas d’usage “terrain” et leur approche en matière de sécurité et de stratégie de gouvernance.

Opter pour la meilleure agence Datalake ne relève pas du hasard. Voici une grille de lecture fine, pour aller au-delà du simple “catalogue d’outils” :

| Critère | Ce qu’il faut demander |

|---|---|

| Expertise secteur | Références clients, retours d’expérience concret |

| Capacité d’intégration | Compatibilité avec vos systèmes ERP/CRM/BI existants |

| Modélisation des données | Méthodologie propriétaire versus frameworks standards (Data Vault…) |

| Automatisation & IA | Usage de LLM, modèles pré-packagés, orchestration de processus |

| Sécurité & conformité | Certificat ISO, politique RGPD, gestion des accès |

| Accompagnement | Phase d’audit, tests, formation, support long terme |

| Maîtrise budgetaire | Transparence des coûts, scénarios de ROI mesurés |

Les agences “tout-technologie” échouent souvent à comprendre les véritables enjeux métiers du client. La meilleure valeur vient du croisement entre savoir-faire sectoriel et robustesse technique.

Entre stockage, gouvernance et exploitation intelligente, chaque agence a son cœur d’expertise. Détail des principales offres retrouvées sur le marché français :

| Type de service | Digitalisim | Yield Studio | Spiriit | Axians | IG Conseils |

|---|---|---|---|---|---|

| Mise en place Datalake | ✔️ | ✔️ | ✔️ | ✔️ | ✔️ |

| Orchestration DataOps | ✔️ | ✔️ | |||

| Gouvernance avancée | ✔️ | ✔️ | ✔️ | ✔️ | |

| Intégration IA | ✔️ | ✔️ | |||

| Marketing & BI | ✔️ | ||||

| Métiers spécifiques | ✔️ (Comptabilité) |

Sur les 5 meilleures agences en France, seules 2 proposent une véritable plateforme DataOps et orchestration industrielle des données métiers.

L’un des plus grands écueils dans les projets Datalake : le manque d’alignement entre les attentes métiers et la réalité technique sur le terrain. Voici deux retours client marquants :

Une ETI du secteur manufacturier a confié à Yield Studio le chantier de son Datalake. Problématique : défragmenter un SI siloïsé, centraliser et modéliser la donnée pour le suivi des performances d’atelier. Résultat : déploiement d’une architecture cloud hybride, reporting métiers automatisés. ROI : réduction de 30% du temps d’analyse décisionnelle.

IG Conseils a permis à un réseau d’experts-comptables de synchroniser en temps réel les données clients, d’automatiser la paie et les mises à jour réglementaires. Le Datalake a fluidifié la transmission d’informations entre équipes et sécurisé l’accès aux documents sensibles.

Demandez systématiquement à l’agence un ou deux contacts de clients pour échanger “off record” : le recul d’un pair vous offrira un aperçu inégalé du vécu réel de la collaboration.

Voici un plan d’action concret pour maximiser votre choix d’agence Datalake :

Un Datalake n’est jamais “seulement” un chantier IT : sa réussite dépend du bon alignement stratégique entre vos enjeux métiers et la capacité d’une agence à personnaliser sa réponse. Tableau de bord, IA ou automatisation : choisissez l’agence Datalake qui saura vraiment porter votre transformation data.

Vous cherchez un partenaire technique mais ne savez pas par où commencer ? Voici les réponses aux questions les plus courantes.

Les entreprises françaises engagées dans des projets Datalake proviennent principalement de secteurs variés : grandes entreprises industrielles (automobile, énergie), établissements financiers (banques et assurances), ETI du numérique et startups SaaS. On compte environ 12 000 entreprises tech recensées en France, un chiffre en progression constante, stimulé par la transformation numérique. Les attentes majeures de ces clients concernent la centralisation sécurisée des données, la rapidité d’accès pour l’analyse, et la conformité stricte au RGPD, avec des exigences accrues pour le data lineage et la gouvernance. Les acteurs cherchent aussi à optimiser leurs projets data science (notamment IA et machine learning), fluidifier l’accès multi-source (IoT, bases métiers, logs applicatifs) et garantir des coûts d’infrastructures maîtrisés. Dans les pôles urbains comme Paris, Lyon ou Toulouse, on observe une forte demande de solutions hybrides (cloud+on-premise), alors que les PME régionales privilégient encore souvent des approches plus progressives ou mutualisées au sein de clusters et réseaux d’innovation locaux.

Le coût d’implémentation d’un Datalake en France varie fortement selon la taille du projet : il débute autour de 60 000 € pour une PME et peut dépasser 500 000 € pour une grande organisation, hors maintenance. Les délais de mise en œuvre fluctuent entre 4 et 12 mois, en fonction de la volumétrie des données, de la complexité des sources à intégrer et des attentes en matière de sécurité. À Paris, où la densité d’agences spécialisées est la plus élevée, la compétition fait parfois baisser les prix de 10 à 15 % par rapport aux régions moins équipées. Les régions comme l’Île-de-France et l’Auvergne-Rhône-Alpes regroupent plus de 40 % des agences françaises actives dans le domaine du Datalake. Les grandes villes bénéficient d’écosystèmes avec ressources spécialisées, ce qui accélère les projets, tandis que les agences en régions basent leur compétitivité sur l’accompagnement personnalisé et une meilleure compréhension des tissus économiques locaux.

Le marché français du Datalake recrute massivement autour de profils Data Engineer, Data Architect, DevOps et Data Security Officer. Selon l’APEC, le salaire moyen annuel d’un Data Engineer dépasse 50 000 € en Île-de-France, mais reste inférieur de 20 % dans d’autres régions, comme les Pays de la Loire ou l’Occitanie. La majeure partie des agences travaille avec des diplômés issus d’écoles d’ingénieurs reconnues (Télécom Paris, IMT, INSA, Polytech), mais de nouveaux talents émergent via des formations spécialisées proposées par des campus numériques ou de grands groupes (Orange, Atos). On note une forte demande de certifications cloud (AWS, Azure, GCP) et une montée du besoin sur la sécurité et la gestion du cycle de vie de la donnée. Le télétravail a renforcé l’attractivité des agences françaises auprès de profils internationaux, mais la tension sur le recrutement reste élevée, notamment hors des métropoles.

La France compte plus de 1,3 million d’emplois dans le numérique en 2023, dont près de 10 % relevant directement de la gestion et de l’exploitation de la donnée. L’Île-de-France, qui concentre plus de 40 % des effectifs, fait figure de leader grâce à la présence de clusters majeurs comme Cap Digital. Auvergne-Rhône-Alpes et l’Occitanie sont également dynamiques (plus de 120 000 emplois et des pôles comme Lyon French Tech ou Toulouse Aerospace Valley). Cependant, des régions comme la Bretagne structurent aujourd’hui un tissu de PME et ETI performantes, portées par l’agroalimentaire ou la cybersécurité. Les disparités demeurent : le taux d’emploi numérique peut varier du simple au double selon les départements (de 2,5 % à 5,5 % des actifs). L’attractivité des agences dépend donc fortement de la vitalité de leur bassin d’emploi et de la proximité avec des écoles spécialisées ou de grands pôles technologiques régionaux.

En France, les agences Datalake privilégient des architectures big data hybrides, alliant solutions open source (Hadoop, Apache Spark) et services managés propriétaires (AWS S3, Azure Data Lake Storage, Google Cloud Storage). Plus de 60 % des nouveaux projets incluent une composante cloud, dans un contexte où la part d’adoption du cloud public est passée de 24 % à 36 % en trois ans (source Syntec Numérique). Les besoins en automatisation, orchestration (Airflow, Kubernetes) et accès sécurisé sont récurrents, avec une sensibilité accrue au respect du RGPD. Au sein des métropoles, on relève une accélération autour du data mesh et de l’automatisation, alors que dans les départements ruraux, l’enjeu reste l’accessibilité et la maîtrise des coûts. Le choix technologique est souvent dicté par la culture des équipes internes du client, la disponibilité des profils sur le territoire et l’historique des outils (SAP, ERP industriels, etc.).

L’accompagnement à la gouvernance des données constitue un enjeu stratégique, en particulier pour les 146 000 PME et 35 000 collectivités territoriales recensées en France. Les agences aident à structurer des politiques de gouvernance adaptées : rédaction de chartes, mise en place de Data Stewardship, outillage de la traçabilité et de l’auditabilité. On observe une forte demande d’ateliers de sensibilisation, animés localement dans des tiers-lieux (fablabs, campus d’innovation, etc.), ou de dispositifs sur-mesure pour anticiper les risques de non-conformité. En 2023, 47 % des ETI françaises ont amorcé une démarche de gouvernance Data, parfois soutenues par des clusters régionaux ou des CCI. Les agences se distinguent selon leur capacité à intégrer les contraintes d’interopérabilité, les volumes de données hétérogènes (capteurs, IoT, ERP), et à orchestrer la montée en compétence interne des équipes métier.

En France, les déploiements Datalake réussis touchent des secteurs clés tels que l’industrie (gestion prédictive des équipements, pilotage qualité), la santé (analyse de cohortes, optimisation du parcours patient), l’énergie (monitoring intelligent, gestion de l’effacement), ou l’agroalimentaire (traçabilité, optimisation des chaînes logistiques). Près de 20 % des grands groupes du CAC 40 indiquent avoir centralisé 80 % de leurs flux de données dans un Datalake, tandis que les startups deeptech innovent sur des modèles de gestion multicloud. Les régions comme Auvergne-Rhône-Alpes ou le Grand Est se démarquent par des cas d’usage en manufacturing et chimie, tandis que Paris et Hauts-de-France s’illustrent dans le retail et la banque. Le succès repose souvent sur la coordination entre les acteurs locaux – entreprises, écoles d’ingénieurs, incubateurs – et une dynamique de co-innovation soutenue par des pôles de compétitivité et des programmes régionaux d’accélération.

La formation aux métiers du Datalake s’intensifie sur tout le territoire. Plus de 60 établissements supérieurs français proposent désormais des cursus spécialisés (Master Data Science, écoles d’ingénieurs, BTS SIO). Les écoles comme l’Ensimag, Télécom Paris, ou les IUT misent sur l’alternance avec les agences et ETI locales. 46 % des professionnels de la donnée affirment avoir suivi une formation continue dans l’année passée, signe d’un marché en mutation rapide. On observe un essor des bootcamps et formations courtes (6 mois), soutenus par les campus régionaux et la Grande École du Numérique. Les régions Parisienne, Lyonnaise et Toulousaine concentrent l’essentiel de l’offre académique, mais des alliances entre clusters locaux et écoles émergent en Hauts-de-France ou en Nouvelle-Aquitaine. Cette dynamique contribue à résorber, partiellement, la pénurie de profils Data qui touche environ 15 % des offres non pourvues sur le territoire.