Eleven Labs

Des experts augmentés par l'intelligence collective.

Des experts augmentés par l'intelligence collective.

Découvrez les meilleures agences Data Vizualisation en France, soigneusement sélectionnées pour leur expertise et leur maîtrise des enjeux propres à la visualisation de données. Opter pour une agence française spécialisée, c’est bénéficier non seulement de compétences techniques pointues, mais aussi d’une réelle compréhension du contexte local et sectoriel. La Fabrique du Net met à votre disposition une sélection rigoureuse des acteurs les plus qualifiés du marché, capables de transformer vos données en leviers stratégiques et visuels percutants. En parcourant notre liste, vous trouverez des partenaires de confiance, à même de répondre à vos besoins spécifiques et de vous accompagner vers des solutions innovantes et sur-mesure. Explorez notre sélection pour identifier l’agence qui saura révéler tout le potentiel de vos données.

Des experts augmentés par l'intelligence collective.

Des experts augmentés par l'intelligence collective.

Des experts augmentés par l'intelligence collective.

Des experts augmentés par l'intelligence collective.

Accompagnement sur mesure sur vos projets IA et Data

Accompagnement sur mesure sur vos projets IA et Data

Banque / Assurance / Fintech

Retail / E-commerce / Consommation

Industrie / Énergie / Ingénierie

Retail / E-commerce / Consommation

Vous avez du mal à choisir votre agence ? Laissez-nous vous aider gratuitement

DreamOnTech vous propulse au-delà de l'imagination !

DreamOnTech vous propulse au-delà de l'imagination !

Votre équipe web, mobile, IA

Votre équipe web, mobile, IA

CRM, IT, DATA, IA

CRM, IT, DATA, IA

Thibaut P.

Gérant • Numenys

12/2025

Services B2B / SaaS / Logiciels

Présentation du projet Mirakl, entreprise experte dans les solutions de marketplace, recherchait une amélioration signif...

Immobilier / Construction / BTP / Mode / Luxe / Beauté

Barnes International : Étude Marketing Automation Barnes International, agence immobilière de prestige, a été accompagné...

🚀 Solutions Digitales Sur-Mesure pour les PME et ETI

🚀 Solutions Digitales Sur-Mesure pour les PME et ETI

Services B2B / SaaS / Logiciels

Mobilité / Transport / Logistique

Services B2B / SaaS / Logiciels / Formation / Coaching / RH

Culture / Médias / Divertissement

L'agence SEO de votre région : une expertise dont vous avez besoin.

L'agence SEO de votre région : une expertise dont vous avez besoin.

Formation / Coaching / RH

Immobilier / Construction / BTP

Marketing / Communication / Branding

Formation / Coaching / RH

Hyperstack accompagne les entreprises à devenir plus performantes et data-driven grâce au no-code, à la data et à l’IA.

Hyperstack accompagne les entreprises à devenir plus performantes et data-driven grâce au no-code, à la data et à l’IA.

Benjamin P.

Ben&Vic

09/2025

Formation / Coaching / RH

One Learn forme des professionnels autour de l’architecture et du design, avec une activité en forte croissance.Pour mie...

Services B2B / SaaS / Logiciels

Copernic souhaitait disposer d’une infrastructure data robuste afin de centraliser ses données Divalto, d’améliorer leur...

Économie sociale / ONG / ESS

Grâce à une transformation technique en profondeur, Agoterra bénéficie désormais d’un back-end solide, automatisé et évo...

Retail / E-commerce / Consommation

Grâce à une automatisation complète du traitement de ses commandes en ligne, SVR dispose désormais d’un flux de données...

Smartfire pilote la fusion de la tech, de la data et de l’IA pour transformer votre site web en moteur de croissance.

Smartfire pilote la fusion de la tech, de la data et de l’IA pour transformer votre site web en moteur de croissance.

Des solutions digitales uniques, créées pour vos besoins

Des solutions digitales uniques, créées pour vos besoins

Stanislas D.

CEO • Healthcube

03/2026

Virtuous Innovators

Virtuous Innovators

Services publics / Éducation

Problème Automatisation des données : informations dispersées L'absence d'automatisation empêche d’obtenir de la visibil...

Industrie / Énergie / Ingénierie / Mode / Luxe / Beauté

Mission : Un acteur du secteur de la parfumerie souhaitait dépasser les limites des solutions AMDIS et Excel pour analys...

We are Eurelis, Smart Applications Maker !

We are Eurelis, Smart Applications Maker !

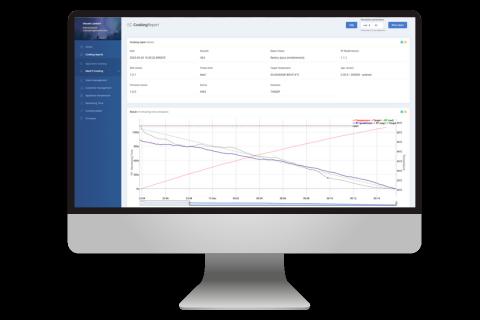

Industrie / Énergie / Ingénierie

Eurelis accompagne Kestrel Vision, leader mondial des systèmes de contrôle et d’inspection industriels, dans la migratio...

Industrie / Énergie / Ingénierie

Eurelis accompagne Mastrad, marque française reconnue d’ustensiles de cuisine innovants, dans la conception, le développ...

Gagnez du temps, boostez vos résultats, innovez durablement. USTS, 10 ans d’expertise au service de vos ambitions digitales

Gagnez du temps, boostez vos résultats, innovez durablement. USTS, 10 ans d’expertise au service de vos ambitions digitales

De l’UX à l’IA, un partenaire digital pour toute votre chaîne de valeur.

De l’UX à l’IA, un partenaire digital pour toute votre chaîne de valeur.

Partenaire de votre transformation Data & IA

Partenaire de votre transformation Data & IA

Ismail M.

Lead Data Engineering - Data Platform Team • Accor

01/2026

Manuel D.

CTO • Madkudu

01/2026

Adrien P.

CTO • Citron

01/2026

Culture / Médias / Divertissement

Contexte et enjeux Notre client, une maison de vente aux enchères de renom, devait relever d’importants défis dans la ge...

Industrie / Énergie / Ingénierie

Contexte Notre client met au point une solution pour digitaliser la gestion énergétique et technique des biens immobilie...

Tourisme / Hôtellerie / Restauration

Objectif de la mission Les dispositifs de fidélité constituent un levier puissant pour une marque, permettant de valoris...

Une IA transparente, fiable et explicable pour optimiser vos processus métier

Une IA transparente, fiable et explicable pour optimiser vos processus métier

Amoddex accompagne vos projets de transformation digitale, sourcing et pilotage de la performance.

Amoddex accompagne vos projets de transformation digitale, sourcing et pilotage de la performance.

Inkidata, institut d’études marketing à Lyon

Inkidata, institut d’études marketing à Lyon

La donnée devient décision, la décision devient résultat

La donnée devient décision, la décision devient résultat

Mesurer, c'est déjà piloter !

Mesurer, c'est déjà piloter !

Capt IA Optimisez l’humain, automatisez l’essentiel

Capt IA Optimisez l’humain, automatisez l’essentiel

Des solutions Microsoft CRM, ERP, BI et Portails sur mesure pour structurer et faire grandir votre PME

Des solutions Microsoft CRM, ERP, BI et Portails sur mesure pour structurer et faire grandir votre PME

-thumb.jpg)

SLAP digital est une agence FR spécialisée sur les problématiques d'acquisition (SEA/SEO/GEO/SMA/Analytics) et d'écosystème digital (Sites, PIM, DAM).

SLAP digital est une agence FR spécialisée sur les problématiques d'acquisition (SEA/SEO/GEO/SMA/Analytics) et d'écosystème digital (Sites, PIM, DAM).

Agence intelligence artificielle, machine learning et data. Experts du développement d'IA sur mesure, ou à partir d'un modèle existant.

Agence intelligence artificielle, machine learning et data. Experts du développement d'IA sur mesure, ou à partir d'un modèle existant.

Rapprochez-vous du lancement de votre prochain projet dès aujourd'hui

Notre méthodologie repose sur des critères objectifs et vérifiables pour garantir la pertinence de nos recommandations.

Voir la méthodologie détailléeClassement impartial basé sur la data. Aucune agence ne paie pour sa note.

Identité légale, santé financière et expertises sont auditées par notre équipe.

Nous modérons les avis pour filtrer les faux témoignages et garantir l'authenticité.

Découvrez les dernières réalisations des meilleures agences

Arbor & Jardin

Maymana

Road Story

Ecoles Vidal

Healthcube

Smoky Brow

HindBoutik

Amélie Cheval

La data visualization, ou visualisation de données, revêt aujourd'hui une importance cruciale dans le monde du data marketing et de l’analytics. Elle consiste à transformer des données brutes en représentations visuelles claires et engageantes, ce qui non seulement facilite la compréhension pour les clients, mais améliore également la prise de décision au sein des entreprises.

La data visualization se définit comme l’art de représenter des informations complexes sous forme de graphiques, tableaux de bord ou rapports visuels. Par exemple, l'utilisation de Google Data Studio ou de Microsoft Fabric permet de créer des tableaux de bord personnalisés illustrant clairement les performances marketing. Ces outils offrent des KPI facilement compréhensibles, rendant les décisions éclairées plus accessibles pour les entreprises. Cela est d'autant plus nécessaire que la capacité à interpréter et exploiter efficacement les données confère aux entreprises un avantage concurrentiel considérable dans l'ère du big data.

Le recours à la data visualization présente de nombreux avantages indéniables. Il permet une interprétation rapide et efficace de sources de données complexes, condition préalable à des stratégies data-driven marketing. En facilitant la visualisation business intelligence, les entreprises peuvent anticiper les tendances, optimiser leurs processus et améliorer la satisfaction clients. Des outils comme Google Analytics et Zoho Analytics illustrent parfaitement comment une analyse visuelle peut transformer des données brutes en insights précieux.

Le choix d'une agence spécialisée en data visualization en France est crucial pour optimiser les résultats de vos projets de visualisation de données. Plusieurs critères doivent être pris en compte pour choisir une agence de data marketing compétente.

Une agence de data visualization doit démontrer une expertise technique solide. L'innovation est primordiale pour intégrer des technologies de pointe comme le machine learning ou l’intelligence artificielle dans leurs solutions. La capacité à rester à la pointe de la technologie assure que vos projets bénéficient des dernières avancées, maximisant ainsi leur impact.

Analyser le portfolio d'une agence vous donne un aperçu de ses réalisations précédentes. Examiner des cas clients et des témoignages aide à évaluer leur capacité à manager des projets complexes et à proposer des solutions sur mesure. Des collaborations avec des entreprises renommées comme EDF ou des projets à Paris et Lyon sont révélateurs de leur qualité et compétence.

La capacité d'une agence à s'adapter aux besoins spécifiques des clients est essentielle. Leur approche devrait être centrée sur le client, avec une compréhension approfondie de leurs attentes, assurant chaque tableau de bord ou rapport répond précisément aux besoins établis.

L’évolution de la data visualization s’accompagne de l’émergence de nouvelles technologies et approches.

L'adoption de technologies émergentes comme Snowflake ou les Customer Data Platforms (CDP) modifie la manière dont les données sont visualisées. L'intégration de ces outils permet des analyses plus rapides, enrichissant ainsi la visualisation des données.

L'évolution vers des solutions centrées sur l'utilisateur met l'accent sur l'expérience utilisateur et sa facilité d'utilisation. Les projets actuels de visualisation de données visent à favoriser des interactions intuitives, stimulant l'engagement et l'efficacité.

Pour garantir le succès de vos projets de data visualization, évaluer la performance de l'agence est fondamental.

Le suivi de projet est déterminant pour mesurer l’impact de la visualisation sur votre entreprise. Utiliser des outils de business intelligence pour analyser les résultats et ajuster vos stratégies est indispensable pour une réussite continue et pérenne.

Les avis et témoignages clients fournissent des insights sur la qualité du service et peuvent guider votre décision vers le choix d'une agence de confiance.

Choisir la bonne agence de data visualization est crucial pour tirer pleinement parti de vos données. En vous concentrant sur l'expertise, l'innovation, la satisfaction client, et en vous appuyant sur des témoignages et un portfolio solide, vous pouvez vous assurer d’un investissement bénéfique apportant des avantages durables et un avantage compétitif à votre entreprise.

Avec un marché mondial de la visualisation de données évalué à 5,7 milliards de dollars en 2022 et prévu de croître annuellement de 10,2 % jusqu'en 2030, l'importance stratégique de la data visualization dans le paysage moderne ne peut être sous-estimée. Dans ce contexte, collaborer avec une agence compétente peut être déterminant pour naviguer dans le monde complexe du big data et des analytics avec confiance et succès.

Vous cherchez un partenaire technique mais ne savez pas par où commencer ? Voici les réponses aux questions les plus courantes.

En France, on compte près de 300 agences spécialisées en Data Visualisation, concentrées en Île-de-France (près de 40 % du marché), mais aussi dans les métropoles comme Lyon, Nantes et Lille, qui bénéficient de pôles numériques structurés. L’Île-de-France s’appuie sur la présence de grands groupes et d’un tissu dense de start-ups, tandis que la région Auvergne-Rhône-Alpes profite de l’écosystème industriel et du cluster Digital League. Les régions Nouvelle-Aquitaine et Occitanie, grâce à la dynamique de Toulouse et Bordeaux, tirent aussi leur épingle du jeu — on y trouve plus de 6000 professionnels du numérique, dont une proportion en hausse dans la Data Science et la visualisation de données. Ce maillage hétérogène offre un choix adapté au tissu économique local, des PME industrielles du Grand Est aux acteurs de la smart-city du Sud, traitant des cas d’usage variés comme le pilotage industriel, l'analyse marketing ou la gouvernance de la donnée publique.

Les coûts varient selon la complexité du projet et l’expertise de l’agence. À l’échelle nationale, le développement d’un dashboard sur-mesure démarre autour de 7 000 € pour un projet simple, et peut grimper à 50 000 € ou plus pour des besoins avancés intégrant de la BI, du temps réel et des volumes massifs de données. En Île-de-France, là où le coût du travail est plus élevé (salaire moyen d’un Data Analyst autour de 48 000 €/an), les tarifs sont généralement 10 à 20 % supérieurs à ceux constatés en régions. Les projets typiques des ETI régionales se situent dans une fourchette de 15 000 à 25 000 €, incluant conception, développement, et accompagnement à la prise en main. Les délais de réalisation s’étalent le plus souvent de 6 à 12 semaines, en lien avec la disponibilité des ressources et la complexité des data flows.

Les agences recherchent une diversité de profils : Data Analysts, Data Scientists, Développeurs BI, UX/UI Designers, et consultants métier. Le secteur emploie environ 10 000 professionnels dans la Data Visualisation au niveau national, soit 12 % de la filière data (source Pôle Emploi). Les régions comme Auvergne-Rhône-Alpes et Nouvelle-Aquitaine se distinguent par la présence d’écoles d’ingénieurs spécialisées (INSA, ENSEEIHT, Epitech) et une forte collaboration avec des pôles de compétitivité (Minalogic, Aerospace Valley). La pénurie de profils seniors, surtout hors grandes métropoles, encourage les agences à investir dans l’alternance et la formation continue, tandis que le télétravail permet de capter des compétences rares dans les bassins ruraux.

En France, Tableau, Power BI et Qlik Sense sont leaders sur le terrain de la Data Visualisation, respectivement adoptées par 32 %, 41 % et 12 % des entreprises utilisatrices. Cela s’explique par leur compatibilité avec les architectures SI des grands groupes, le soutien actif des éditeurs et la présence de communautés locales très structurées, notamment à Paris (meetups réguliers) et dans les métropoles comme Nantes ou Toulouse. À cela s’ajoutent des solutions open source telles que Kibana ou D3.js, prisées dans les écosystèmes startup pour leur souplesse et coût maîtrisé. Les secteurs industriels (automobile, aéronautique) privilégient souvent des outils robustes comme Qlik ou Power BI, alors que les acteurs du retail et du e-commerce misent sur des visualisations web interactives développées sur mesure.

Le panel de clients est large : grands groupes (banques, énergie), ETI industrielles, collectivités territoriales, mais aussi startups de la « French Tech ». Près de 56 % des missions recensées concernent l’aide à la décision pour PME et ETI entre 50 et 500 salariés. Les collectivités locales, notamment dans les régions Pays de la Loire et Occitanie, commandent des tableaux de bord pour piloter politiques publiques et open data. L’industrie et le secteur santé, surtout dans les bassins de Lyon, Lille ou Aix-Marseille, sollicitent les agences pour des visualisations avancées d’indicateurs qualité ou de suivi logistique. Les startups de la French Tech, dont Paris concentre plus de 30 %, recherchent des interfaces très UX et des visualisations temps réel pour leurs plateformes SaaS.

La Data Visualisation profite du développement rapide du secteur de la data, qui enregistre une croissance annuelle de plus de 7 % sur les trois dernières années. Selon l’INSEE, plus de 85 000 emplois directs sont recensés dans la filière data/IA en 2023 en France, dont environ 12 000 concernent directement la visualisation et les interfaces BI. L’Île-de-France concentre 38 % de ces effectifs, tandis qu’Auvergne-Rhône-Alpes, Occitanie et les Hauts-de-France s’affirment comme nouveaux pôles compétitifs. Les salaires débutent à 36 000 € brut/an pour un Data Visualisation Developer junior, et dépassent 50 000 € pour des profils seniors ou spécialisés sur des technologies rares. La montée en puissance de clusters régionaux, comme Cap Digital (Paris), Eurobiomed (Sud-Est), accélère encore l’attractivité du secteur en région.

Un projet type débute par un cadrage (1 à 2 semaines), où l’agence analyse les sources de données, les besoins métier et les usages cibles. Vient la phase de prototypage, généralement sous forme de maquettes interactives sous Power BI ou Tableau, sur 2 à 3 semaines. S’ensuit l’intégration technique et le développement des dashboards, sur 3 à 6 semaines, en lien avec le département IT client. Enfin, la formation des utilisateurs et l’accompagnement au changement prennent 1 à 2 semaines supplémentaires, portés souvent par des consultants certifiés. Le process inclut toujours un volet conformité RGPD — cruciale pour les entreprises basées en Île-de-France ou dans la santé (normes HDS). En moyenne, un tel projet s’étale sur 8 à 12 semaines. Plus de 60 % des agences proposent aussi des offres de maintenance ou d’évolution post-mise en production.

La montée en puissance du cloud (Azure, AWS, Google Cloud) transforme durablement la Data Visualisation : 65 % des entreprises françaises prévoient de déplacer tout ou partie de leur analytic sur le cloud d’ici 2025. L’essor de l’open data et de la dataviz citoyenne, porté par des initiatives publiques (2000 portails open data locaux ouverts depuis 5 ans), impacte aussi la demande. On note une forte adoption des technologies de visualisation en temps réel, notamment dans la mobilité urbaine (Paris, Lyon, Bordeaux), l’industrie (IoT) et la cybersécurité. Les formations Data Viz, via écoles d’ingénieurs (Mines, Centrale) ou écoles spécialisées en design numérique, ont vu leurs effectifs croître de 15 % en deux ans, signe d’une structuration de la filière. L’automatisation, l’IA générative et la personnalisation des visualisations seront les leviers d’innovation majeurs à horizon 2026.