ChatGPT à l’école : comment repérer un devoir écrit par une IA ?

L’IA générative s’est propagée dans les salles de classe. En quelques secondes, des outils comme ChatGPT ou Gemini peuvent rédiger une dissertation, résumer un chapitre ou répondre à une question complexe.

Sans surprise, les élèves s’en servent. Beaucoup. Certaines études montrent que plus d’un étudiant sur deux utilise déjà l’IA pour ses devoirs.

Pour les enseignants, une nouvelle question se pose : le devoir a-t-il été écrit par l’élève… ou par une IA ?

Le problème, c’est que ces textes sont souvent très propres : bien structurés, sans fautes, avec des arguments équilibrés. Pas toujours facile de faire la différence.

Heureusement, certains signaux peuvent mettre la puce à l’oreille. Et des détecteurs d’IA comme ZeroGPT permettent aujourd’hui d’analyser un texte pour estimer s’il a été généré par une intelligence artificielle.

L’IA à l’école : un défi pour les enseignants

L’adoption de l’IA générative dans l’éducation est fulgurante. ChatGPT a atteint 100 millions d’utilisateurs en seulement deux mois, un record pour une application grand public. Et les élèves font clairement partie des utilisateurs.

💡Les chiffres parlent d’eux-mêmes

Selon plusieurs enquêtes récentes, près de 9 étudiants sur 10 utilisent déjà l’IA dans leurs études. Dans certains sondages, plus de 80 % des lycéens déclarent s’en servir pour leurs devoirs.

Les usages varient : chercher des idées, reformuler un texte, générer un plan… mais aussi parfois rédiger directement une réponse complète.

Pour les enseignants, le défi est nouveau. Les outils classiques de détection du plagiat ne suffisent plus : un texte généré par IA est original, donc impossible à repérer avec les méthodes traditionnelles.

👉 L’enjeu n’est plus seulement de détecter du copier-coller, mais d’identifier un contenu potentiellement généré par une intelligence artificielle.

Peut-on vraiment détecter un devoir écrit par une IA ?

La réponse courte : pas à 100 %. Les modèles d’IA progressent vite. Très vite. Un texte généré peut être fluide, bien structuré, sans faute. Parfois, il ressemble parfaitement à un devoir classique.

Il n’existe donc pas de méthode miracle.

Dans la pratique, les enseignants s’appuient plutôt sur un faisceau d’indices :

- un style inhabituel pour l’élève ;

- une structure trop parfaite ;

- des arguments très génériques ;

- ou un niveau soudainement beaucoup plus élevé.

Autre aide précieuse : les détecteurs d’IA. Ces outils analysent un texte et estiment la probabilité qu’il ait été généré par un modèle comme GPT.

Ce n’est pas une preuve absolue. Mais c’est souvent un bon point de départ pour vérifier un devoir.

Avant même d’utiliser un outil, certains signes peuvent déjà mettre la puce à l’oreille.

Les signes qui peuvent trahir un devoir écrit par une IA

Avant même d’utiliser un outil de détection, certains indices peuvent alerter. Un devoir généré par IA laisse souvent des traces dans le style ou la structure du texte.

Un texte trop propre

Premier signal classique : un texte presque trop parfait. Pas de fautes, des phrases bien construites, un vocabulaire soutenu et très homogène.

Sur le fond, tout est correct. Mais le texte peut paraître un peu lisse, sans hésitation ni approximation – ce qui est assez rare dans un devoir d’élève.

Une structure très scolaire

Les IA ont tendance à produire des textes très formatés :

- une introduction qui reformule le sujet ;

- deux ou trois parties équilibrées ;

- une conclusion qui résume.

C’est propre… mais souvent très prévisible.

Des arguments très génériques

Autre indice fréquent : des idées justes mais assez superficielles. Le texte explique, reformule, synthétise… mais donne peu d’exemples précis ou d’expérience personnelle.

On a l’impression d’un devoir correct, mais un peu impersonnel.

Un niveau qui change brusquement

Dernier signal : un écart avec le niveau habituel de l’élève.

Un devoir très structuré, avec un vocabulaire académique, alors que les productions précédentes étaient beaucoup plus simples… peut évidemment susciter des questions.

Ces indices ne prouvent rien à eux seuls. Mais combinés, ils peuvent déjà mettre la puce à l’oreille.

👉 Pour aller plus loin, certains enseignants utilisent ensuite des outils capables d’analyser le texte plus en profondeur.

Comment détecter un devoir écrit par une IA avec ZeroGPT

Quand un doute persiste, il est possible d’analyser un texte avec un détecteur d’IA. C’est précisément le rôle d’outils comme ZeroGPT.

L’idée est simple : analyser la structure du texte pour estimer s’il a été rédigé par un humain… ou par un modèle de langage.

Comment fonctionne ZeroGPT

ZeroGPT s’appuie sur un modèle d’analyse appelé DeepAnalyse™.

L’outil examine plusieurs dimensions du texte :

- la structure globale du devoir

- la manière dont les idées s’enchaînent

- la construction des phrases

- certaines formulations typiques des modèles d’IA

L’analyse se fait à deux niveaux.

D’abord au niveau global : organisation du texte, équilibre des paragraphes, logique de l’argumentation. Les contenus générés par IA ont souvent une structure très régulière.

Ensuite au niveau des phrases. L’outil cherche des patterns linguistiques fréquents dans les textes générés par des modèles comme ChatGPT, Gemini, Claude ou LLaMA.

Pour cela, ZeroGPT s’appuie sur un modèle de deep learning entraîné sur de larges corpus de textes : contenus web, données éducatives et textes générés par différents modèles d’IA.

Comment vérifier un devoir avec ZEROGPT

L’utilisation est très simple :

- copiez le texte du devoir ;

- collez-le dans l’outil ZEROGPT ;

- lancez l’analyse.

En quelques secondes, la plateforme affiche :

- un score de probabilité IA ;

- les phrases potentiellement générées par une IA ;

- un pourcentage global de contenu suspect.

Cela ne remplace évidemment pas l’analyse d’un enseignant. Mais c’est un outil rapide pour vérifier un texte et repérer des signaux faibles.

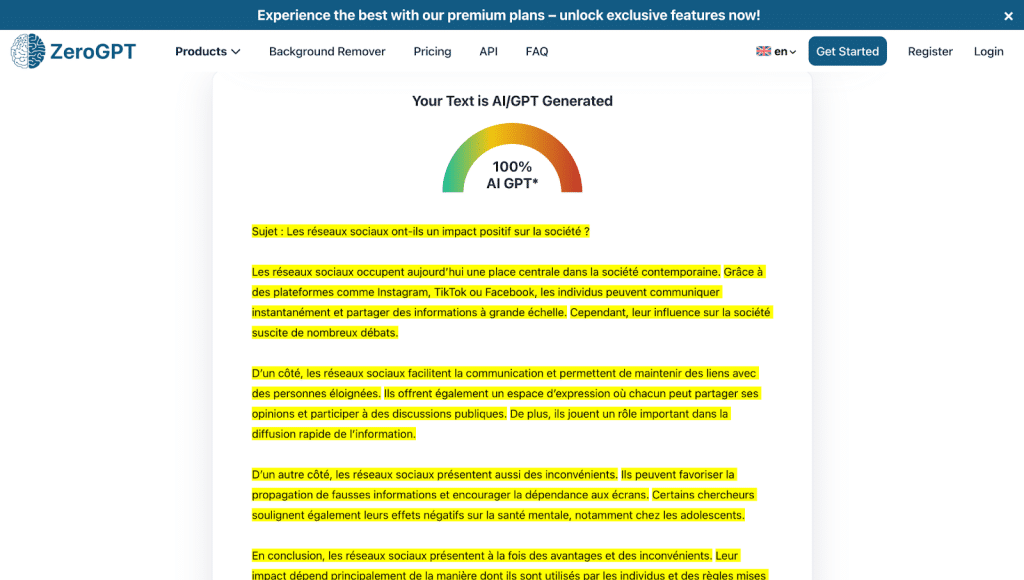

Pour voir comment l’outil réagit, on a testé ZeroGPT sur un texte typiquement généré par IA.

L’analyse met en évidence les passages détectés comme générés par un modèle de langage et attribue un score global indiquant une forte probabilité d’origine IA.

Les limites des détecteurs d’IA

Comme tous les outils de détection d’IA, ZeroGPT fonctionne à partir d’analyses statistiques du langage.

Le résultat doit donc être interprété comme un indicateur, pas comme une preuve définitive. Un score élevé signifie simplement que le texte présente des caractéristiques fréquentes dans les contenus générés par IA.

Dans un contexte scolaire, ces outils servent surtout à orienter l’analyse d’un devoir. Ils permettent de repérer des signaux et d’ouvrir la discussion avec l’élève, mais ne remplacent pas le jugement pédagogique.

Conclusion – L’IA change les règles du jeu à l’école

L’IA générative s’est installée dans le quotidien des élèves. Et elle ne va pas disparaître. Résumés, plans de dissertation, réponses rédigées : ces outils font désormais partie de l’environnement scolaire.

Pour les enseignants, la question n’est donc plus seulement de repérer le plagiat classique. L’enjeu devient d’identifier des contenus potentiellement générés par une IA.

Certains indices peuvent alerter : un style très lisse, une structure trop parfaite, des arguments génériques. Mais dans bien des cas, la lecture seule ne suffit pas.

👉C’est là que des détecteurs d’IA comme ZeroGPT peuvent aider. En quelques secondes, ils analysent un texte et mettent en évidence des signaux typiques des contenus générés par IA.Pas une preuve absolue.Mais un outil utile pour éclairer l’analyse d’un devoir et ouvrir la discussion avec l’élève.

Logiciels recommandés Détecteur IA